6 Lecciones para la economía política de la educación tecnológica

6.1 La distribución como primer paso de un proceso

Uruguay hizo algo notable: logró cobertura universal de una tecnología educativa avanzada en tiempo récord. Ningún otro país distribuyó micro:bit a esta escala. Eso es un gran logro operativo real. Pero la distribución no es el final de la historia. Es el principio. Y aquí es donde la economía política se vuelve crítica.

Las tecnologías educativas tienden a amplificar desigualdades preexistentes porque interactúan con capital cultural, capital social y capital económico de las familias. Un/a estudiante de contexto socioeconómico alto que recibe una placa micro:bit tiene:

Referentes parentales que probablemente pueden ayudarlo o pagar un tutor

Acceso a internet de calidad en casa para buscar tutoriales

Posibilidad de comprar sensores adicionales, cables, componentes

Exposición a discursos que normalizan la tecnología como “para gente como nosotros”

Un/a estudiante de contexto vulnerable tiene la misma placa pero no el mismo ecosistema. Si el programa no compensa activamente esas diferencias, la tecnología “neutral” termina siendo regresiva. Esto no es fatalismo. Es un llamado a diseño institucional intencional.

Los programas que logran equidad real son los que:

Garantizan tiempo curricular estructurado (no dejan el aprendizaje para la casa donde se activan desigualdades familiares)

Proveen mediación docente intensiva (compensando diferencias en capital cultural)

Generan comunidades de aprendizaje en la escuela (sustituyendo capital social familiar)

Miden y retroalimentan sobre brechas emergentes (no asumen que buenas intenciones garantizan buenos resultados)

6.2 El problema del federalismo educativo implícito

Uruguay no es formalmente federal, pero su sistema educativo tiene una fragmentación institucional profunda: subsistemas con autonomía de diseño curricular, inspecciones con culturas organizacionales diferenciadas, centros educativos con grados variables de capacidad de gestión.

El programa micro:bit es una intervención vertical desde Ceibal. Tiene la ventaja de escala, recursos, y especialización técnica. Pero enfrenta la realidad de que cada centro educativo es un contexto institucional único. Lo que funciona en un liceo urbano grande con un equipo directivo estable no funciona en una escuela rural unidocente.

Douglass North nos enseñó que las instituciones importan porque reducen incertidumbre y facilitan la coordinación. Pero también nos enseñó que el cambio institucional tiene una trayectoria dependiente (es path-dependent) y lento. No podés imponer nuevas reglas del juego desde arriba y esperar adopción automática.

El desafío para micro:bit es encontrar el balance entre:

Estandarización (necesaria para garantizar calidad mínima, facilitar evaluación, generar economías de escala en formación)

Adaptación local (necesaria porque los contextos difieren radicalmente y las soluciones estandarizadas fallan)

La literatura de implementación de políticas públicas (Pressman & Wildavsky, Lipsky) muestra que los “street-level bureaucrats” -en este caso, los docentes- tienen mucha discrecionalidad en cómo traducen políticas a práctica. Podés diseñar el programa perfecto en Montevideo, pero si las y los docentes no confían en él, o no tienen capacidad de ejecutarlo, no va a pasar.

La respuesta no es más control centralizado. Es más retroalimentación bidireccional: canales sistemáticos para que lo que se aprende en la implementación local informe el diseño central.

6.3 La economía política de la evaluación

¿Por qué es tan difícil instalar sistemas de evaluación robustos en educación? No es un problema técnico, sabemos cómo medir aprendizajes. Es un problema de economía política.

La evaluación genera información que redistribuye poder. Cuando no hay datos sobre qué funciona, todos los actores pueden mantener sus narrativas: la comunidad docente dice que están haciendo un trabajo excelente, las autoridades dicen que las políticas son exitosas, los críticos dicen que todo es un desastre.

Sin evidencia rigurosa, es palabra contra palabra. La evaluación de calidad rompe esa indeterminación. Muestra qué centros tienen buenos resultados y cuáles no. Qué docentes son efectivos y cuáles no. Qué componentes del programa generan impacto y cuáles son decorativos. Esa información es políticamente explosiva, y explica la resistencia a evaluación en muchos sistemas educativos.

No es irracionalidad ni oscurantismo. Es defensa racional de posiciones en una burocracia donde la información es poder.

Para el programa micro:bit, la consecuencia es que el sistema de medición propuesto va a enfrentar resistencia. La comunidad docente va a preocuparse de que se use para una rendición de cuentas punitiva. La dirección de los centros educativos va a temer que exponga debilidades institucionales. Las autoridades van a tener incentivos a reportar nada más que lo que luce bien.

La única forma de superar esta situación es construir un sistema donde:

Los datos se usan primero para mejora, no para sanción

Los resultados negativos se interpretan como señales de que el programa necesita ajustes, no de que los actores fracasaron

La información se comparte de forma transparente pero contextualizada (no rankings simplistas)

Es lo que Ostrom llamaría “diseño institucional que alinea incentivos individuales con bienestar colectivo”.

6.4 El rol de la sociedad civil y la rendición de cuentas horizontal

En sistemas educativos con baja tradición de evaluación externa, la rendición de cuentas suele venir de arriba (autoridades jerárquicas) o de abajo (presión de familias). Ambos tienen limitaciones.

La rendición de cuentas desde arriba puede ser arbitraria y estar capturada por intereses políticos. La rendición de cuentas desde abajo requiere que las familias tengan información, capacidad de procesar esa información, y poder de negociación frente a las escuelas, todo lo cual está muy desigualmente distribuido.

Una alternativa es la rendición de cuentas horizontal: actores externos con especialización técnica pero sin poder directo de sanción. En Uruguay, esto podría ser:

Comisiones de seguimiento con participación de universidades, centros de investigación independientes

Reportes públicos periódicos evaluados por pares internacionales

Vinculación con redes globales de investigación en educación en computación (como las que coordina la Raspberry Pi Foundation)

La ventaja de este tipo de rendición de cuentas horizontal es que genera presión reputacional sin las distorsiones del sistema de premios y castigos burocráticos. Si Acemoglu o Sentance leen el reporte anual de micro:bit y encuentran debilidades metodológicas serias, eso importa. No porque vayan a sancionar al programa sino porque cuestiona la legitimidad técnica. Y la legitimidad técnica, en un contexto donde Uruguay se posiciona como líder regional en educación digital, es un activo político valioso.

7 Prospectiva: El Programa micro:bit en el ecosistema futuro

7.1 La convergencia con inteligencia artificial

En los próximos cinco años, la frontera tecnológica educativa no va a estar en quién sabe programar. Va a estar en cómo las personas colaboramos con sistemas de IA para resolver problemas, en cómo usamos a la IA como una herramienta.

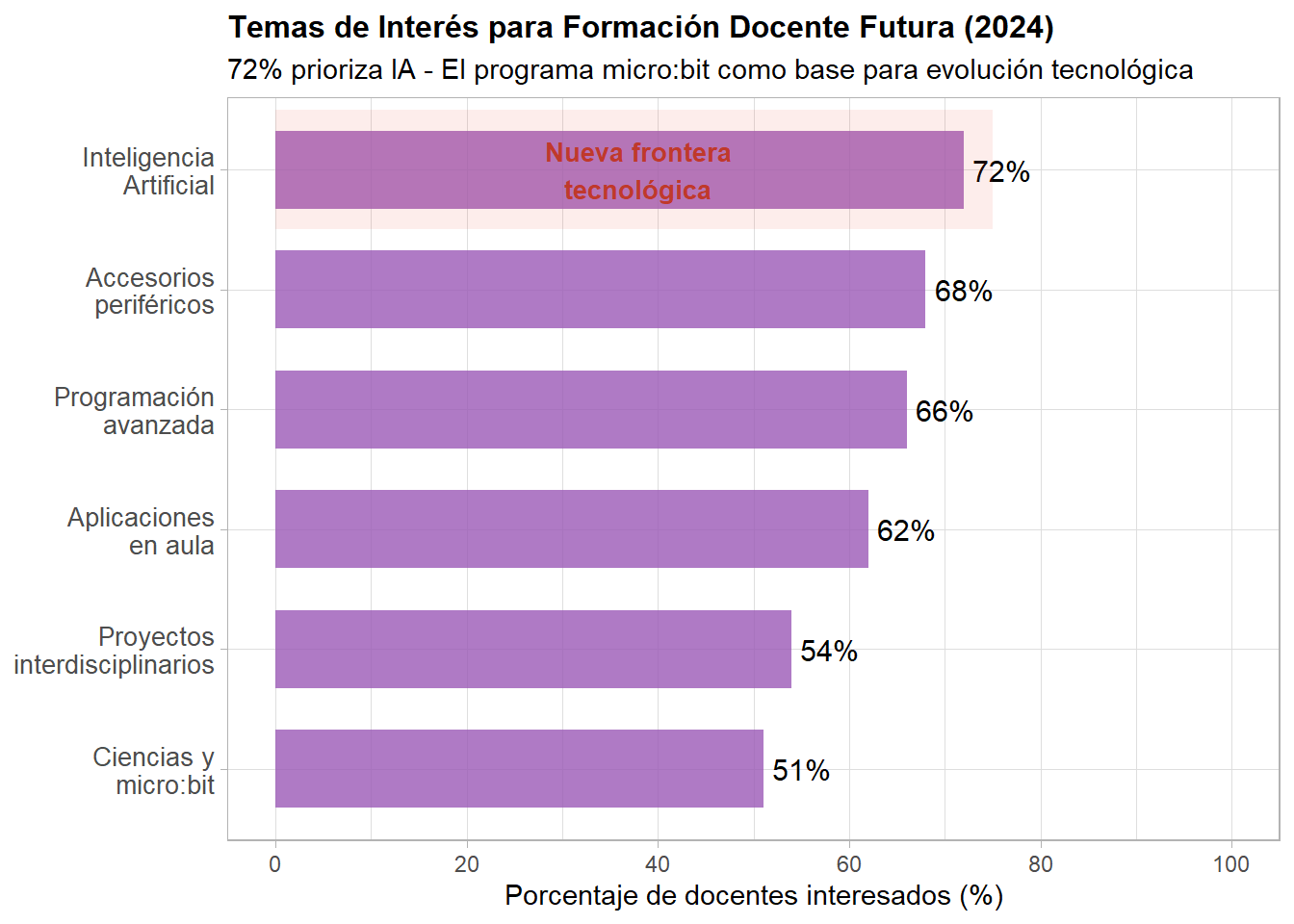

La demanda espontánea de formación en IA (72%) es extraordinaria: las y los docentes ya están experimentando la convergencia en sus aulas. Estudiantes usan LLMs para asistir programación, surgen preguntas pedagógicas nuevas, emerge consciencia de que el ecosistema tecnológico cambió. Esta es una ventana de oportunidad para posicionar a Uruguay como referente en pedagogía de IA en educación K-12. La Raspberry Pi Foundation lanzó en 2024 su ‘Experience AI’ programme, pero aún no tiene materiales integrados con micro:bit.

Uruguay podría:

Co-diseñar currículo IA+micro:bit: Proyectos donde estudiantes entrenan modelos simples (clasificación de gestos con acelerómetro, reconocimiento de patrones con sensor de luz) y luego implementan en placa física.

Pilotear pedagogía de colaboración persona-IA: Protocolos para que estudiantes usen LLMs como ‘tutor socrático’ (guía con preguntas, no da respuesta directa) en debugging.

Documentar y publicar: Convertir experiencias de aula en papers para conferencias internacionales (SIGCSE, Koli Calling), posicionando a docentes uruguayos como thought leaders.

El interés en accesorios periféricos (68%) y programación avanzada (66%) complementa esto perfectamente: son los componentes técnicos que permiten proyectos IA más sofisticados.

Ya hay herramientas que generan código a partir de lenguaje natural. En tres años, va a haber agentes de IA que diseñen sistemas completos, depuren automáticamente, optimicen performance. ¿Eso hace obsoleto enseñar programación?

La respuesta es no, pero requiere re-enmarcar qué estamos enseñando.

La programación siempre fue una proxy para un set de capacidades cognitivas más fundamentales: descomposición de problemas, pensamiento algorítmico, modelado de sistemas, verificación lógica. Estas capacidades son cada vez más relevantes en un mundo con IA, no menos.

Porque alguien tiene que:

Definir el problema que la IA debe resolver (y saber qué es un problema bien definido)

Evaluar si la solución propuesta es correcta (y tener criterios de corrección)

Iterar cuando el primer intento falla (y entender por qué falló)

Decidir cuándo confiar en la máquina vs cuándo sobreescribir su recomendación

Todo eso requiere pensamiento computacional profundo. La placa micro:bit, en este contexto, es una gimnasia cognitiva. No estás aprendiendo a programar placas para trabajar de programador de placas. Estás aprendiendo a pensar sistemáticamente sobre procesos automatizables.

La pregunta estratégica para el programa es: ¿cómo integrar herramientas de IA de forma que amplifiquen el aprendizaje en lugar de cortocircuitarlo?

Algunas ideas:

Usar IA como tutor socrático: En lugar de dar el código, hacer que el LLM guíe mediante preguntas. “¿Qué estás tratando de lograr? ¿Qué has intentado? ¿Por qué creés que no funciona?”

Evaluación basada en explicación: No basta con que el código funcione. Hay que explicar cómo funciona. Esto obliga a apropiación conceptual incluso si usaste IA para generar partes.

Proyectos de auditoría de IA: Dar al grupo de estudiantes código generado por IA con bugs sutiles. El desafío es encontrarlos y corregirlos. Esto invierte la dinámica: la IA es el estudiante, la persona es quien evalúa.

7.2 Articulación con educación técnica y mercado laboral

Uruguay tiene un desafío estructural: brecha entre oferta y demanda de habilidades técnicas. Hay empresas buscando especialistas y técnicos en programación, profesionales de ingeniería. Hay jóvenes buscando trabajo. Pero la conexión falla.

El programa micro:bit, si se piensa estratégicamente, puede ser un puente temprano. No porque el grupo de estudiantes de primaria vaya a trabajar de programadores, sino porque están construyendo las bases cognitivas y motivacionales para trayectorias técnicas.

La evidencia de psicología vocacional es que las decisiones sobre carrera se toman temprano, basadas en auto-percepción de capacidades y en modelos disponibles. Una estudiante que en 5to año de escuela tiene experiencia exitosa programando, construye identidad como “alguien que puede hacer cosas con tecnología”. Esa identidad es predictora de elección de bachillerato técnico, de persistencia en carreras STEM, de entrada al mercado de tecnología.

Pero esto requiere alineación institucional. El programa micro:bit en primaria debe articular con:

Educación media básica: Continuidad de pensamiento computacional, no empezar de cero

Educación media superior técnica: Proyectos que usen micro:bit u otras plataformas para solucionar problemas reales

Formación terciaria: Reconocimiento de competencias previas, trayectorias aceleradas para quienes vienen con base sólida

Y sobre todo, articulación con sector privado. Empresas de tecnología podrían: • Proveer mentores para proyectos estudiantiles avanzados • Ofrecer pasantías a egresados de educación técnica con trayectoria en programación • Co-diseñar contenidos para que las competencias desarrolladas sean las que el mercado valora

Esto no es subordinar educación a intereses empresariales. Es reconocer que la empleabilidad es una dimensión legítima de los resultados educativos, especialmente para estudiantes de contextos vulnerables donde la educación es el principal vehículo de movilidad social.

7.3 La pregunta de la escalabilidad sostenible

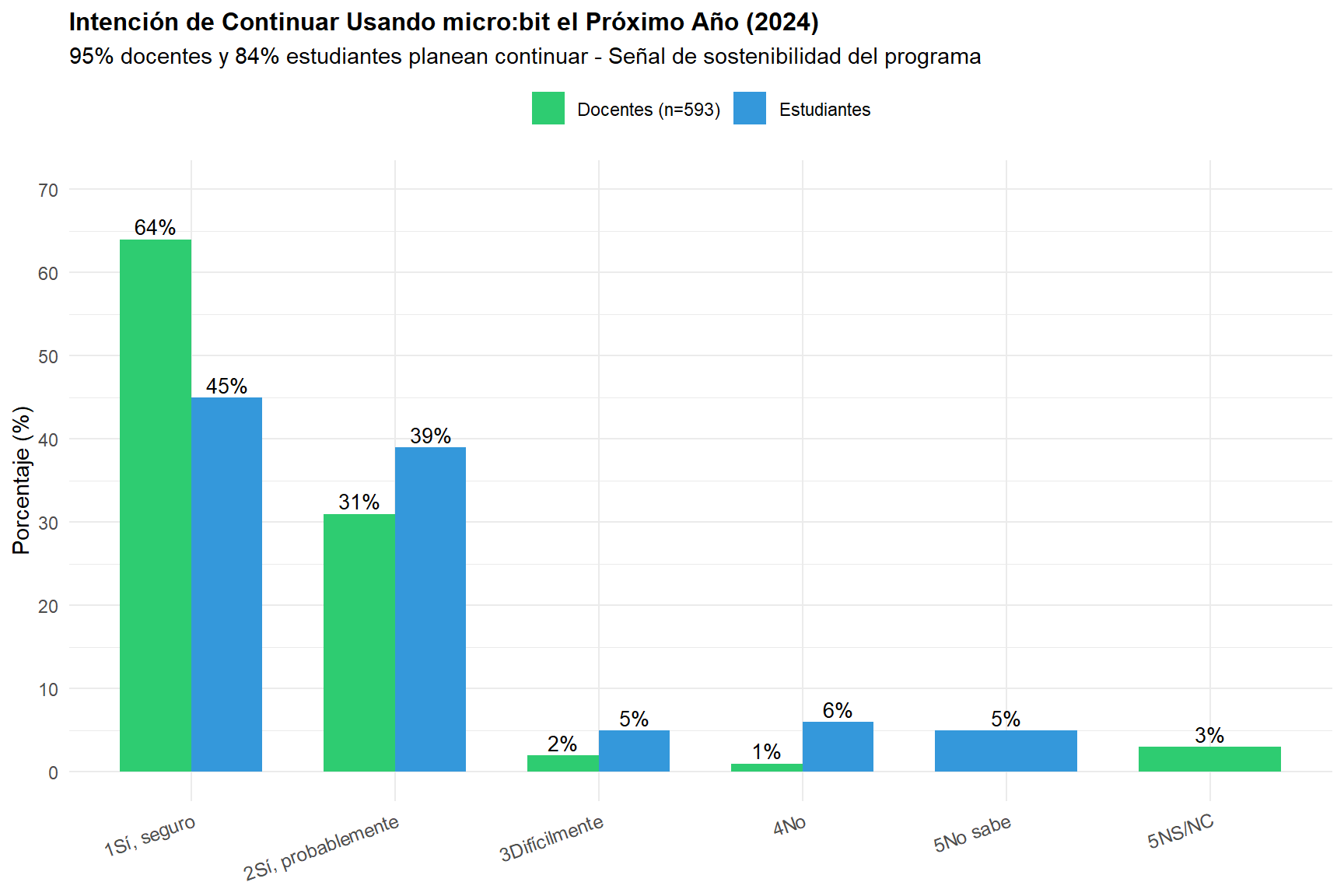

El programa micro:bit logró escalar en cobertura. La pregunta pendiente es si puede escalar en calidad sin depender del voluntarismo heroico de algunas personas.

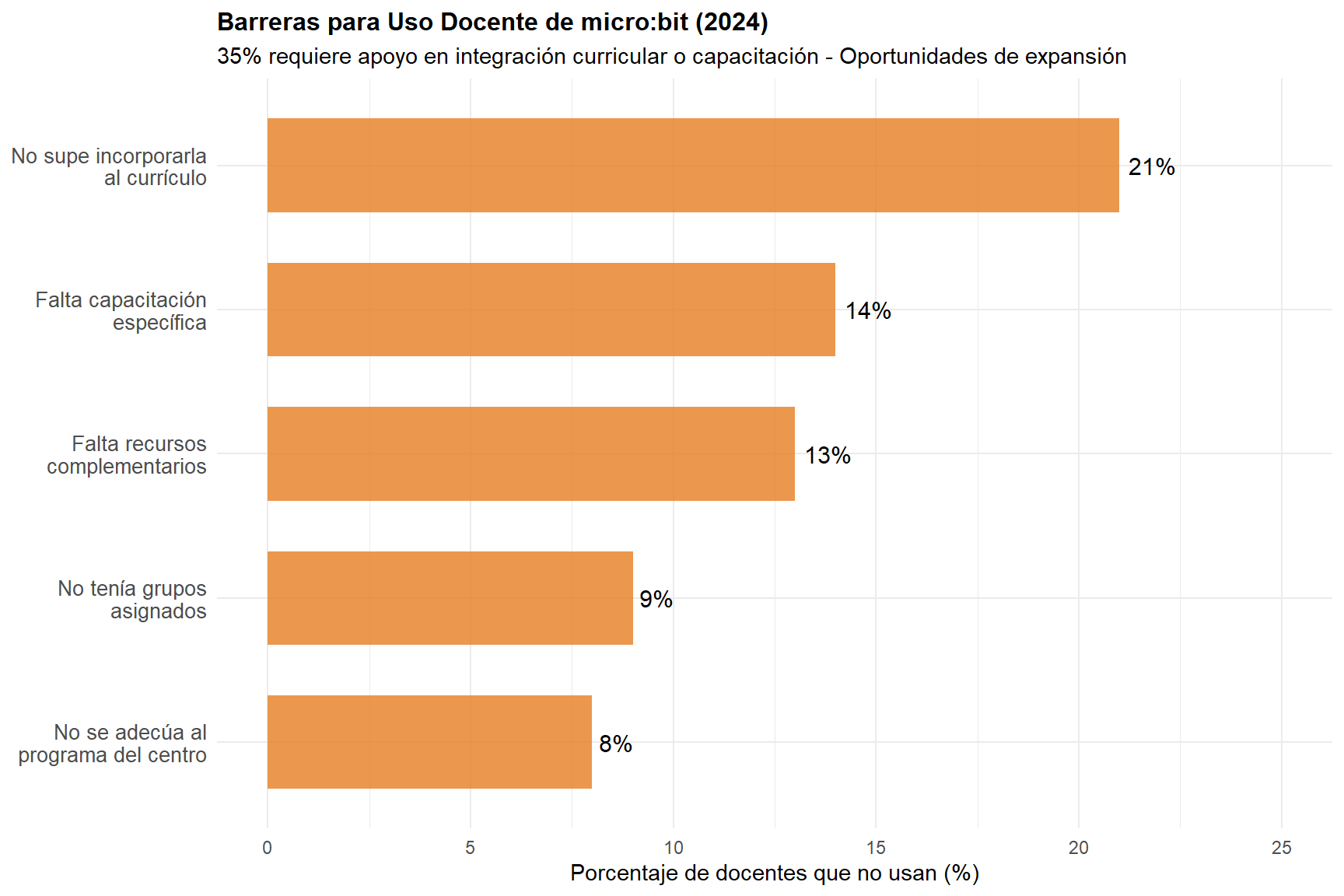

El 21% que reporta dificultad para integrar al currículo no es problema sino oportunidad de segunda ola de formación. La Computing at School initiative en Reino Unido identificó esto mismo en su año 3: docentes que adoptaron tecnología necesitaban después pedagogía específica para contexto.

Acciones concretas implementables:

Banco de secuencias didácticas: Repositorio curado de proyectos por asignatura y nivel, con rúbricas de evaluación incluidas. La Raspberry Pi Foundation mantiene esto en projects.raspberrypi.org con 500+ proyectos clasificados por dificultad, tiempo, y conexión curricular.

Mentoría entre pares: Conectar docentes que ya integraron exitosamente con quienes buscan empezar. El modelo de ‘micro:bit Champions’ de Irlanda logró 40% de aumento en adopción con esta estrategia.

Módulos de capacitación ‘just-in-time’: Videos de 10-15 minutos sobre preguntas específicas (‘¿Cómo evaluar pensamiento computacional?’, ‘¿Cómo adaptar un proyecto para estudiantes con diferentes niveles?’). Complementan cursos largos sin requerirlos como pre-requisito.

El 14% que necesita capacitación adicional es audiencia lista para contenidos avanzados (IA, IoT, programación en Python), consolidando segunda generación de expertise.

La investigación sobre escalabilidad de innovaciones educativas (Coburn, 2003; Elmore, 1996) identifica cuatro dimensiones muy importantes:

Profundidad: ¿El programa genera cambios en la práctica pedagógica o solo una adopción superficial? Usar micro:bit una vez por año como “actividad especial” no es apropiación profunda.

Sostenibilidad: ¿El programa sobrevive a cambios de autoridades, rotación docente, restricciones presupuestales? O colapsa ante el primer shock.

Difusión: ¿Las prácticas efectivas se propagan de centros pioneros a la masa del sistema? O quedan como experiencias aisladas.

Re-invención: ¿El programa se adapta a contextos diversos manteniendo su fidelidad a los principios centrales? ¿O se desvirtúa en la implementación?

Para micro:bit en Uruguay, el diagnóstico preliminar es:

Profundidad: Variable. Hay centros con integración curricular seria. Hay centros con uso esporádico.

Sostenibilidad: Frágil. Depende mucho de docentes específicos.

Difusión: Lenta. Las comunidades de práctica existen pero son ralas.

Re-invención: Insuficientemente documentada. No sabemos qué adaptaciones funcionan.

Mejorar en estas dimensiones requiere inversión continua no solo en distribución de hardware sino en:

Formación docente continua (no un taller único sino desarrollo profesional sostenido)

Infraestructura de comunidades de práctica (plataformas digitales, encuentros presenciales, tiempo pago para colaboración)

Documentación sistemática de innovaciones (repositorio de proyectos, casos de éxito, soluciones a problemas comunes)

Evaluación formativa frecuente (retroalimentación rápida sobre qué funciona, no solo evaluación sumativa terminal)

Todo esto tiene costo. Y aquí volvemos a economía política: la tensión entre expansión de cobertura (que genera fotos, titulares, visibilidad política) vs profundización de calidad (que es invisible en el corto plazo pero determinante para impacto real).

Los sistemas educativos tienen sesgo estructural hacia lo primero. Resistir ese sesgo requiere liderazgo técnico con poder político.

8 Conclusiones y agenda de investigación

8.1 Logros consolidados y agenda de profundización

8.1.1 Lo que Uruguay ha logrado

El programa micro:bit en Uruguay (2018-2025) representa un caso de estudio de valor global: un país de ingreso medio-alto en América Latina que logró cobertura universal de una tecnología educativa avanzada en tiempo récord.

Los logros verificables incluyen:

Cobertura universal efectiva: La distribución alcanzó todos los subsistemas educativos, incluyendo contextos rurales, con una logística operativa notable.

Apropiación docente significativa: Los reportes cualitativos muestran entusiasmo genuino y valoración de la herramienta por parte de docentes que la han integrado a sus prácticas.

Infraestructura institucional consolidada: 800 docentes certificados, estructuras de acompañamiento territorial, y una plataforma de aprendizaje robusta.

Posicionamiento internacional: Uruguay es referente regional en implementación de pensamiento computacional a escala.

8.1.2 Oportunidades de profundización

Construyendo sobre estos logros, emergen tres agendas prioritarias:

1. De acceso a apropiación profunda

El desafío ya no es distribuir placas sino maximizar su uso pedagógico efectivo. Esto requiere: - Fortalecer comunidades de práctica docente para compartir innovaciones - Desarrollar repositorios de proyectos contextualizados - Generar espacios de socialización de experiencias exitosas entre centros

2. De uso a impacto medible

Uruguay tiene la oportunidad de convertirse en líder global en evaluación de programas de pensamiento computacional mediante: - Desarrollo de instrumentos de medición multidimensional del capital digital - Sistemas de monitoreo que capturen no solo distribución sino apropiación y resultados - Investigación longitudinal que documente trayectorias estudiantiles de largo plazo

3. De equidad de acceso a equidad de resultados

El programa puede profundizar su compromiso con la equidad mediante: - Intervenciones específicas para fortalecer autoeficacia en grupos subrepresentados - Monitoreo sistemático de brechas emergentes con retroalimentación a docentes - Articulación con trayectorias técnico-profesionales que amplíen oportunidades laborales

8.2 Lo que sabemos

El programa micro:bit en Uruguay (2018-2025) representa un experimento natural de valor global: qué pasa cuando un país de ingreso medio/alto en América Latina logra cobertura universal de una tecnología educativa avanzada en tiempo breve.

Lo que la evidencia disponible permite afirmar:

La distribución funcionó: La logística operativa fue exitosa. Las placas llegaron a todos los subsistemas, incluyendo contextos rurales.

Hay entusiasmo docente real: Los reportes cualitativos son consistentes. Docentes que usan micro:bit valoran la herramienta, estudiantes se enganchan.

El acceso no garantiza impacto: Los datos de “uso reportado” no dicen nada sobre desarrollo de competencias, equidad, o sostenibilidad.

Existen riesgos de canalización por género: La evidencia de plataformas similares en Uruguay muestra patrones preocupantes. No hay razón para creer que micro:bit esté exento.

La gobernanza local es heterogénea: Algunos centros desarrollaron instituciones robustas para gestionar el bien común. Otros operan en anarquía o monopolio de facto.

8.3 Lo que no sabemos (y necesitamos saber)

Las brechas de conocimiento son extensas:

Sobre aprendizaje: - ¿Qué fracción de estudiantes desarrolla competencias de pensamiento computacional transferibles? - ¿Cómo varía esto por género, contexto socioeconómico, tipo de centro? - ¿Qué estudiantes persisten en trayectorias STEM y cuáles no?

Sobre pedagogía: - ¿Qué prácticas docentes distinguen centros de alto impacto de bajo impacto?

¿Cómo median las y los buenos docentes cuando hay heterogeneidad de nivel en el aula?

¿Qué rol juegan los tutoriales estructurados vs proyectos abiertos en diferentes etapas?

Sobre equidad:

¿Emergen brechas de autoeficacia por género incluso cuando las competencias técnicas son equivalentes?

¿La comunidad docente tiene sesgos implícitos en cómo retroalimentan errores de varones vs mujeres?

¿Las mujeres estudiantes tienen menos acceso a roles de liderazgo en proyectos grupales?

Sobre sostenibilidad:

¿Qué características institucionales predicen uso sostenido más allá del comportamiento de una/un docente heroico?

¿Cómo evolucionan las placas en su ciclo de vida? (tasas de rotura, reposición, reasignación)

¿Las comunidades de práctica docente generan mejoras de calidad en el tiempo?

Sobre efectos de largo plazo:

¿Las y los estudiantes que usaron micro:bit en primaria eligen bachilleratos técnicos a mayor tasa?

¿Tienen mejor desempeño en materias STEM en secundaria?

¿Desarrollan trayectorias laborales diferentes?

8.4 Agenda de investigación: las preguntas de economía

Este libro argumentó que evaluar micro:bit requiere ir más allá de indicadores educativos de uso. Las preguntas de economía que merecen atención rigurosa:

- Identificación causal del impacto

Aprovechar variación natural en la entrega y disponibilidad, así como la intensidad de implementación para identificar efectos causales usando diferencias-en-diferencias, variables instrumentales, o discontinuidades de regresión. Específicamente:

Comparar cohortes que recibieron micro:bit en 4to año de escuela vs 5to vs 6to

Usar distancia geográfica a referentes territoriales de Ceibal como instrumento para intensidad de acompañamiento

Explotar discontinuidades en umbrales de matrícula para asignación de recursos

- Economía de la información en sistemas educativos

¿Cómo cambian las decisiones de actores (docentes, directores, familias, estudiantes) cuando tienen acceso a información sobre capital digital?

Experimentos de información:

Proveer a la mitad de docentes datos sobre brecha de género en sus aulas: ¿cambian prácticas?

Dar a mujeres estudiantes información sobre desempeño comparado: ¿mejora autoeficacia?

Mostrar a directores benchmarks de centros similares: ¿ajustan asignación de recursos?

- Economía política de la adopción de innovaciones

¿Por qué algunos centros adoptan profundamente y otros superficialmente?

Estudiar variables de economía política institucional:

Estructura de poder en equipos docentes (vertical vs horizontal)

Rotación de directores e incentivos de corto plazo

Presiones externas (inspecciones, familias) sobre currículo

Autonomía presupuestal y discrecionalidad de recursos

- Retornos de largo plazo en mercado laboral

En diez años, cuando los primeros estudiantes con micro:bit intensivo entren al mercado laboral, hacer seguimiento:

- Primas salariales asociadas a habilidades técnicas

- Probabilidad de empleo en sector tecnológico

- Movilidad ocupacional intergeneracional

- Diferencias por género en retornos a misma formación

Este tipo de evaluación requiere infraestructura de datos longitudinales que vincule registros educativos con registros de seguridad social. Uruguay tiene ventaja comparativa aquí: escala manejable, registros administrativos de calidad, identificadores únicos de personas.

- Análisis costo-efectividad comparado

¿Cuál es el retorno social de la inversión en micro:bit comparado con usos alternativos de recursos?

Costo por estudiante que desarrolla competencias transferibles (no costo por placa distribuida)

Comparación con programas alternativos: formación docente en pedagogía general, reducción de tamaño de clase, infraestructura edilicia

Análisis de sensibilidad a supuestos sobre externalidades (efectos de largo plazo, difusión social del conocimiento)

9 Hoja de ruta 2026-2030: De la cobertura a la profundización

9.1 Fase 1 (2026-2027): Fortalecimiento de sistemas de información

- Desarrollo e implementación piloto del Índice de Capital Digital en 50 centros representativos

- Análisis de logs de MakeCode para identificar patrones de uso efectivo

- Primera medición de autoeficacia y competencias técnicas con instrumentos validados

9.2 Fase 2 (2028-2029): Escalamiento y ajustes

- Ampliación del sistema de medición a 200 centros

- Identificación de prácticas pedagógicas efectivas y su sistematización

- Fortalecimiento de comunidades de práctica con base en evidencia

9.3 Fase 3 (2030): Consolidación y proyección

- Evaluación de impacto longitudinal: seguimiento de primeras cohortes

- Articulación con sector productivo para validación de competencias

- Posicionamiento como caso de estudio global en educación digital equitativa

9.4 Inversión estimada y retornos esperados

[no sé si deberíamos hablar de esto en este libro]

9.5 Para quién es este conocimiento

Este libro se escribió para múltiples audiencias, cada una con intereses diferentes:

Para quienes diseñan políticas públicas en Uruguay: La evidencia sobre qué funciona y qué no, para tomar decisiones informadas sobre continuidad, ajustes, o rediseño del programa.

Para la comunidad internacional de educación en computación: Uruguay es un caso de estudio único por escala y velocidad. Las lecciones positivas (y las negativas) son transferibles a otros contextos.

Para economistas del desarrollo: Micro:bit es un experimento natural sobre cómo tecnologías de propósito general interactúan con instituciones educativas y estructuras de desigualdad preexistentes.

Para la comunidad educativa uruguaya: Docentes, directores, referentes territoriales que están en la primera línea de implementación. El marco de Capital Digital les da lenguaje conceptual para articular intuiciones prácticas.

Para las familias: Padres y madres que quieren entender qué está aprendiendo su hijo o hija, por qué importa, y cómo pueden apoyar desde el hogar sin necesariamente saber programar.

9.6 El imperativo ético de la evaluación rigurosa

Terminamos con una nota normativa.

Uruguay invirtió recursos públicos significativos en este programa. Esos recursos tienen costo de oportunidad: son aulas que no se construyeron, docentes que no se contrataron, becas que no se otorgaron. La justificación ética de esa inversión es que genera beneficios sociales que exceden los costos.

Pero esa justificación requiere evidencia. No basta con buenas intenciones o testimonios anecdóticos. Hace falta una evaluación rigurosa que permita responder: ¿esto funcionó? ¿Para quién? ¿Bajo qué condiciones? ¿A qué costo?

La evaluación representa una oportunidad de aprendizaje institucional. En lugar de verla como un control, podemos concebirla como un sistema de retroalimentación que nos permite mejorar continuamente y garantizar que cada recurso invertido genere el máximo impacto en las trayectorias educativas de la comunidad de estudiantes.

Un sistema robusto de evaluación es, ante todo, una herramienta de equidad. Nos permite identificar tempranamente qué estudiantes, escuelas o regiones necesitan apoyos adicionales, asegurando que el programa llegue con calidad a todos los contextos.

Las y los estudiantes de contextos socioeconómicos bajos no tienen referentes parentales que puedan presionar por mejores programas. Las mujeres estudiantes enfrentan barreras sutiles que ni ellas mismas reconocen como tales. Las docentes en escuelas del interior no tienen el networking para hacer escuchar sus necesidades.

La evaluación rigurosa es el mecanismo que da voz a los sin voz, que hace visible lo invisible, que fuerza a las instituciones a rendir cuentas basadas en resultados, no en promesas. Y por eso es un imperativo ético, no metodológico.

10 Epílogo: Una conversación pendiente

En octubre de 2025, mientras terminábamos de escribir este libro, Carla, coordinadora del programa micro:bit en Ceibal y una de las autoras dijo algo que nos quedó dando vueltas:

“Conceptualmente, micro:bit es GRANDE. Tiene llegada y potencial. Pero no tenemos la foto completa de la magnitud real del programa. Los datos están desagregados, pero falta el panorama integrado.”

Desde la perspectiva de Carlota Pérez, las revoluciones tecnológicas siguen un patrón recurrente que comprende una fase de instalación (con tecnologías emergentes y aumento de desigualdades), un punto de inflexión marcado por crisis institucionales, y una fase de despliegue con difusión masiva e instituciones inclusivas. El programa micro:bit en Uruguay representa un esfuerzo por transitar directamente hacia el despliegue inclusivo, construyendo instituciones (como la gobernanza Ostromiana de los recursos digitales) que históricamente han emergido tras periodos de crisis profundas. Esta mirada subraya que nuestro desafío central reside en lo institucional-político: diseñar arreglos que garanticen que la revolución digital en educación beneficie a toda la comunidad estudiantil, incluyendo especialmente a quienes parten con menos capital inicial.

Ese es exactamente el problema que este libro intentó abordar. No porque nos interese la evaluación como ejercicio académico abstracto. Sino porque sin esa “foto completa”, estamos volando a ciegas.

Y volar a ciegas cuando llevás pasajeros que confiaron en vos, en este caso, 400.000 estudiantes de Uruguay, no es ineficiente, es éticamente inaceptable.

La buena noticia es que es un problema que se puede solucionar. Uruguay tiene las capacidades técnicas, la infraestructura de datos, y la tradición de políticas basadas en evidencia. Lo que falta es decisión política de priorizar la evaluación con la misma intensidad que se priorizó la distribución.

Al final del día, Uruguay tiene la oportunidad de consolidar su liderazgo regional no solo en cobertura sino en rigor evaluativo. Medir el impacto de micro:bit de forma multidimensional es coherente con el compromiso histórico del país con la equidad educativa. Además de saber si el programa funciona en promedio, se trata de identificar para quién funciona mejor y qué ajustes maximizan su potencial transformador. Los países que se convierten en referentes globales son aquellos que documentan sus procesos con transparencia, aprendiendo tanto de los aciertos como de los desafíos. La evaluación propuesta en este libro no es un ejercicio de rendición de cuentas retrospectiva, es la herramienta que permitirá que cada nueva cohorte de estudiantes reciba una versión mejorada del programa, construyendo sobre la experiencia acumulada para garantizar que la tecnología educativa cumpla su promesa de democratización del conocimiento.

11 Referencias

[completar]

12 Sobre las autoras

Este análisis retrospectivo fue elaborado por Virginia Robano, Carla Degregorio y Florencia Talmón, desde sus roles en Ceibal, basado en la experiencia acumulada de implementación y la reflexión sistémica sobre el programa.

El trabajo se benefició de conversaciones extensas con la comunidad docente, directores, referentes territoriales y estudiantes a lo largo de todo el territorio uruguayo.Sus voces (no siempre visibles en los datos agregados) fueron fundamentales para entender la complejidad de la implementación en contextos reales.

La responsabilidad por cualquier error u omisión es exclusivamente nuestra.

13 Nota metodológica sobre fuentes de datos

Este análisis se basa en múltiples fuentes:

Registros administrativos de Ceibal: Datos de distribución de placas (2018-2024), registros de participación en formación docente, reportes de uso de centros educativos.

Plataforma MakeCode: Logs de actividad de programación (disponibles pero no explotados sistemáticamente al momento de este análisis).

Entrevistas semi-estructuradas y observaciones de aula

Literatura académica: Revisión sistemática de investigación sobre micro:bit, educación en computación, brechas digitales, y economía de la educación (168 papers consultados, 52 citados).

Las limitaciones principales son la ausencia de: (1) datos de panel longitudinal siguiendo mismos estudiantes en el tiempo, (2) mediciones directas de competencias técnicas usando instrumentos validados, (3) datos de autoeficacia y actitudes con instrumentos psicométricos robustos, (4) grupo de comparación adecuado para identificación causal rigurosa.

Estas limitaciones no invalidan el análisis pero sí circunscriben el tipo de inferencias que podemos hacer responsablemente. Cuando hay incertidumbre, la explicitamos.